UGVは、進路計画や環境認識などを行うことができるインテリジェントな自律走行車であり、現在、インテリジェントカーの開発方向として注目されている。無人車両は、搭載されたセンサーによって周囲の状況や自身の状態情報を認識し、ナビゲーションやポジショニングといった独自の機能を持ち、経路計画や特定の目標物の発見といったプロセスを完結することができる。 インテリジェント無人車両の研究にとって、核となるコンテンツはナビゲーション制御技術である。

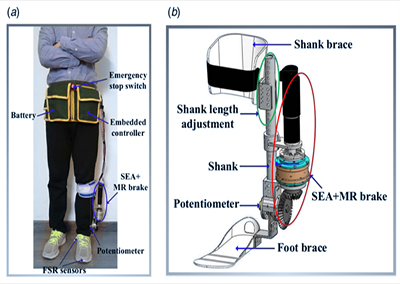

異なる天候や時間条件下では、単一のナビゲーションだけでは高精度な測位ナビゲーションのニーズを満たすことができません。さまざまな環境下で無人車両に搭載されるセンサーは、その特性もさまざまで、現在一般的に使われているセンサーは慣性計測素子(IMU)や超広帯域(UWB)、車輪型走行距離計などです。

哈尔滨工業大学の研究者は、UGVシステムの適応性と信頼性を高めるために、マルチソースセンサ情報の融合に基づくナビゲーションシステムを研究している。 センサ情報の非同期融合とセンサ故障の存在という問題に対して、各センサ情報を因子に抽象化する因子グラフモデルと、ベイズ木構造に基づく漸進平滑最適化アルゴリズムを用いて融合フレームワークを確立し、( ISAM2)を用いてセンサ情報を処理・融合することで、最小二乗法に近い精度を保証しつつ、効率的な計算が可能となり、システム全体の頑健性・信頼性を大幅に向上させることができる。

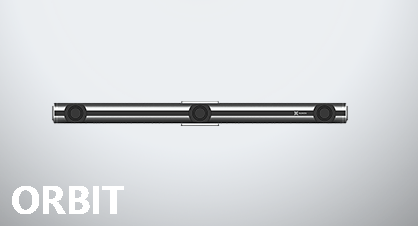

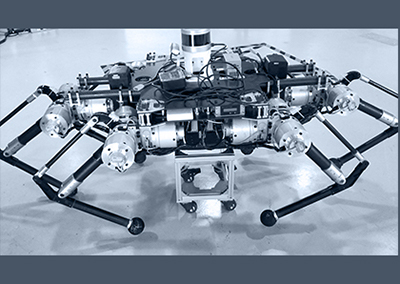

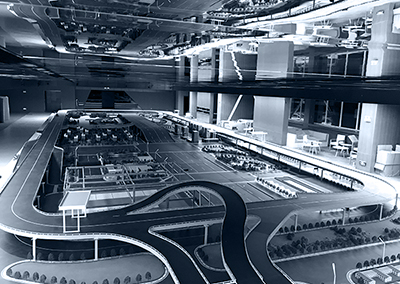

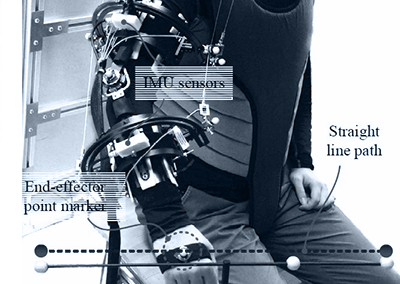

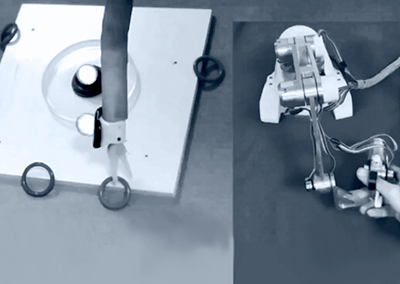

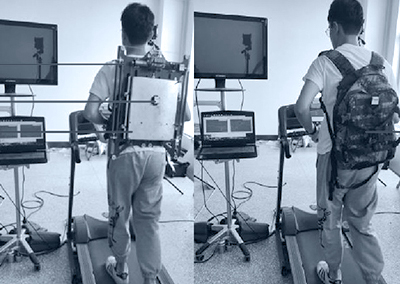

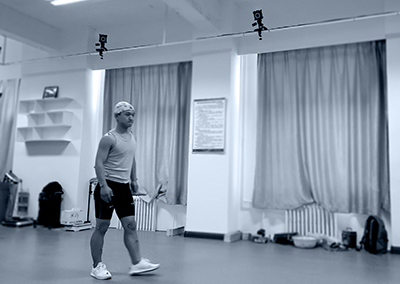

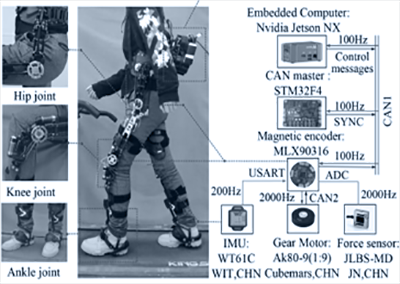

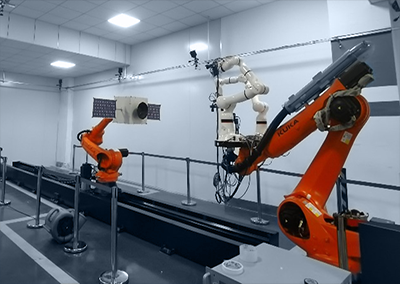

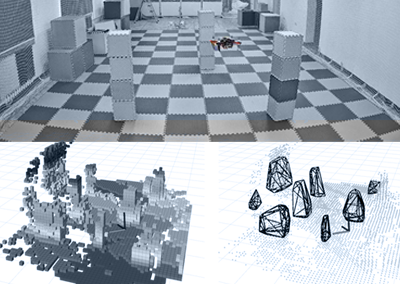

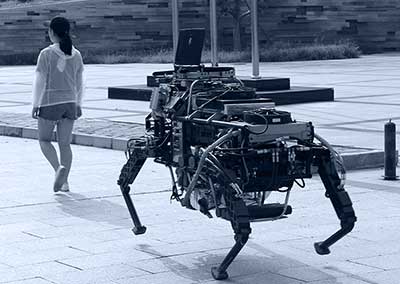

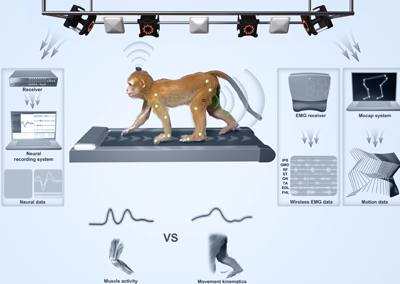

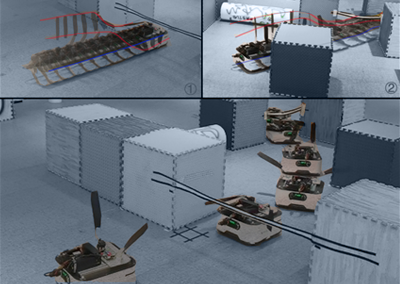

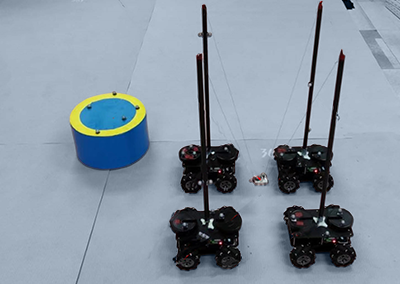

本研究では、UGVが比較的低速で走行する室内環境に着目し、慣性計測素子、超広帯域、オドメトリの3つのセンサーからのデータを融合して、無人走行車の走行を実現しました。 このアルゴリズムの性能を検証するため、研究者らはマルチセンサー情報融合プラットフォームを構築しました。プラットフォームには、MTi-G-700(IMU)、LinkTrack S(UWB)、オドメーター(ODOM)などのオンボードセンサーを搭載したscout2.0 mobile machine quadを使用し、実験プラットフォームはUbuntuをベースにROSを使って同時データ取得を行っています。

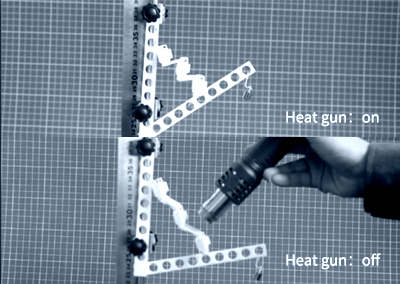

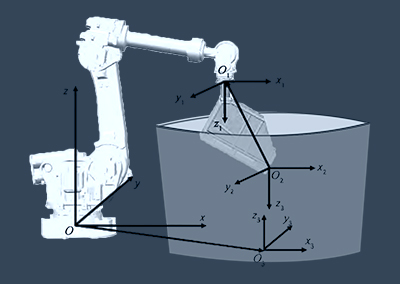

UWB基地局の設置場所

IMU、UWB搭載位置

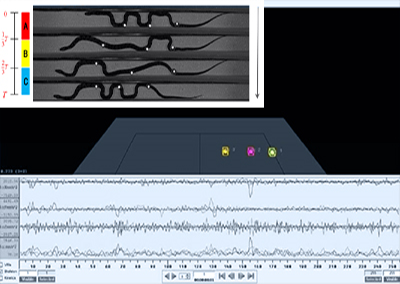

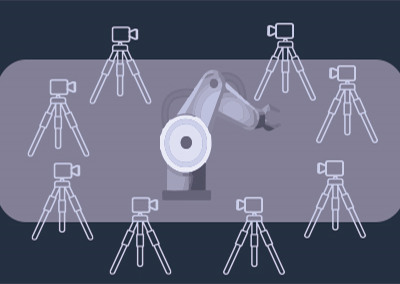

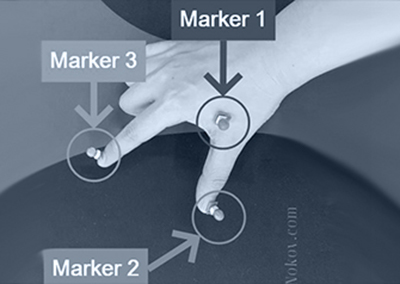

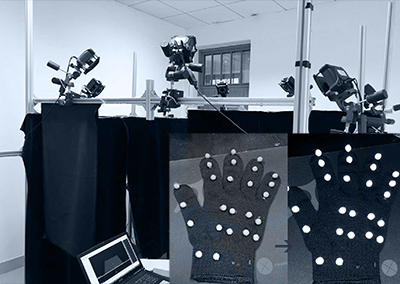

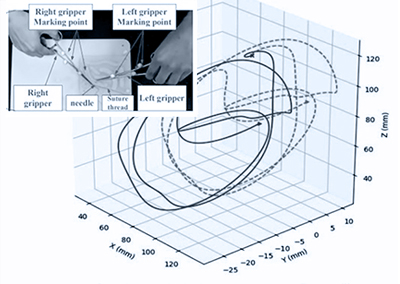

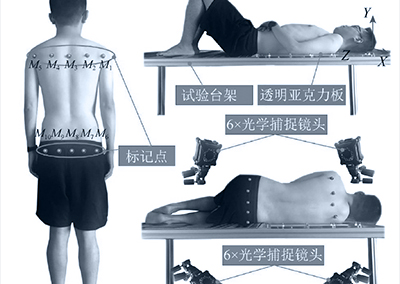

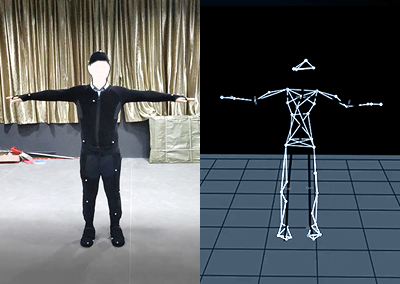

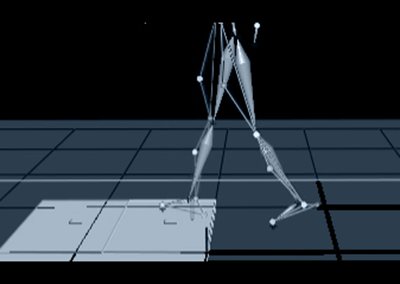

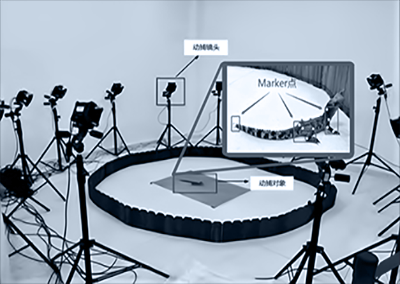

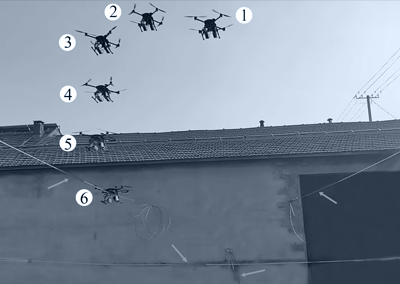

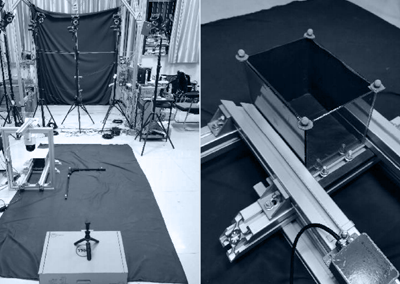

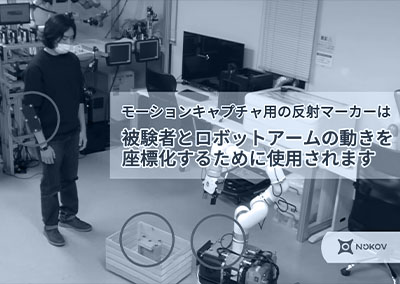

台車の位置の真値を求めるため、実験に使用したNOKOVモーションキャプチャシステムは、フィールド(フィールドは約5m×5m)の上に配置した16個のMarsレンズにより、台車に貼られた3つの反射マーキングポイントを識別し、UGVの真の位置を決定する。 モーションキャプチャーの位置精度はサブミリ単位であるため、カートの運動軌跡の真値として最適なのです。

NOKOVモーションキャプチャシステム

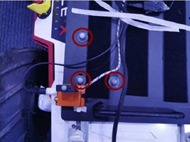

リジッドボディの取り付け位置

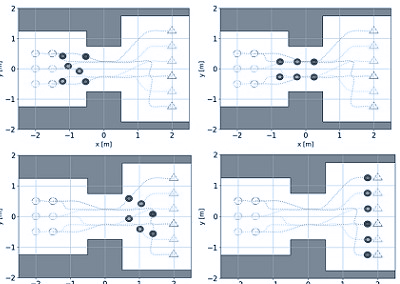

定位効果を分析するために、実験ではIMU+UWB+ODOMの融合データとモーションキャプチャシステムで収集した実測値の比較、および個々のセンサの定位効果を実測値と比較して分析することに焦点を合わせています。

この結果から、単一センサには一定の限界があり、融合アルゴリズムによって単一センサの位置特定効果を改善できることがわかり、本論文のアルゴリズムの実現可能性を示しています。 また、この手法の効率性とロバスト性を分析し、この手法が計算効率を大幅に向上させ、一部のセンサーが故障した場合でも、より正確な位置情報を取得できるほどロバストであることを証明しました。

参考文献。シェン・ヘ・ビン無人車両のためのマルチソースセンサ情報融合ナビゲーション技術に関する研究[D].哈尔滨工業大学, 2021. DOI:10.27061/d.cnki.ghgdu.2021.004020.

ここでごニーズを出ること

-

もっと多い情報に関して、メッセージをしたりしてください。

-

- 確認